MIT Deep Learning Algorithm пропустил важный первый тест

MIT разработал алгоритм глубокого обучения, который успешно прошел тест Тьюринга для звука.

Тест Тьюринга

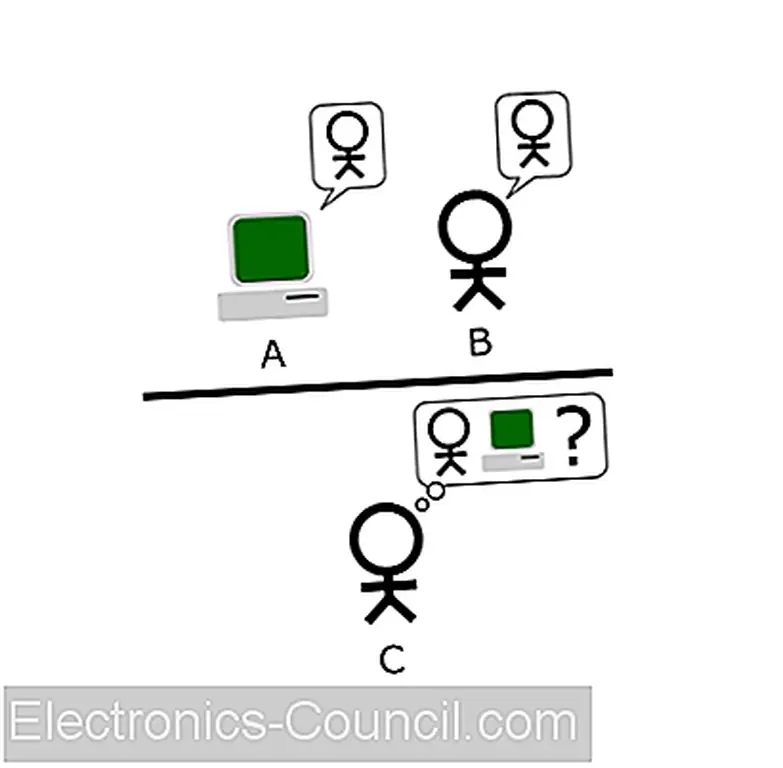

Тест Тьюринга был разработан Аланом Тьюрингом как способ измерения того, насколько хороша машина для подражания человеческому поведению. Прохождение теста означает, что разница между машиной и человеком незаметна.

Описание классического теста Тьюринга, в котором тестеру (C) предлагается определить, является ли A или B человеком или машиной. Изображение предоставлено Wikimedia

В популярной культуре Тест Тьюринга часто изображается как компьютер, пытающийся казаться как можно более человечным до такой степени, что люди принимают его как своего собственного.

Однако это только одно применение теста Тьюринга, который имеет разные типы. Например, некоторые машины могут имитировать звуки человека, в то время как другие могут визуально конкурировать с тем, что может сделать человек, что является большим шагом к автономным транспортным средствам.

Алгоритм глубокого обучения MIT

MIT разработал глубокий алгоритм обучения, способный оценивать физические взаимодействия в видео и звуки, возникающие в результате этих взаимодействий. Алгоритм был обучен в течение нескольких месяцев, используя более 1000 видеороликов с 46 000 звуков ударяемых объектов, поцарапанных или ткнул барабанной палочкой. Барабанная палочка использовалась, потому что она обеспечивала постоянный звук при попадании на каждый объект.

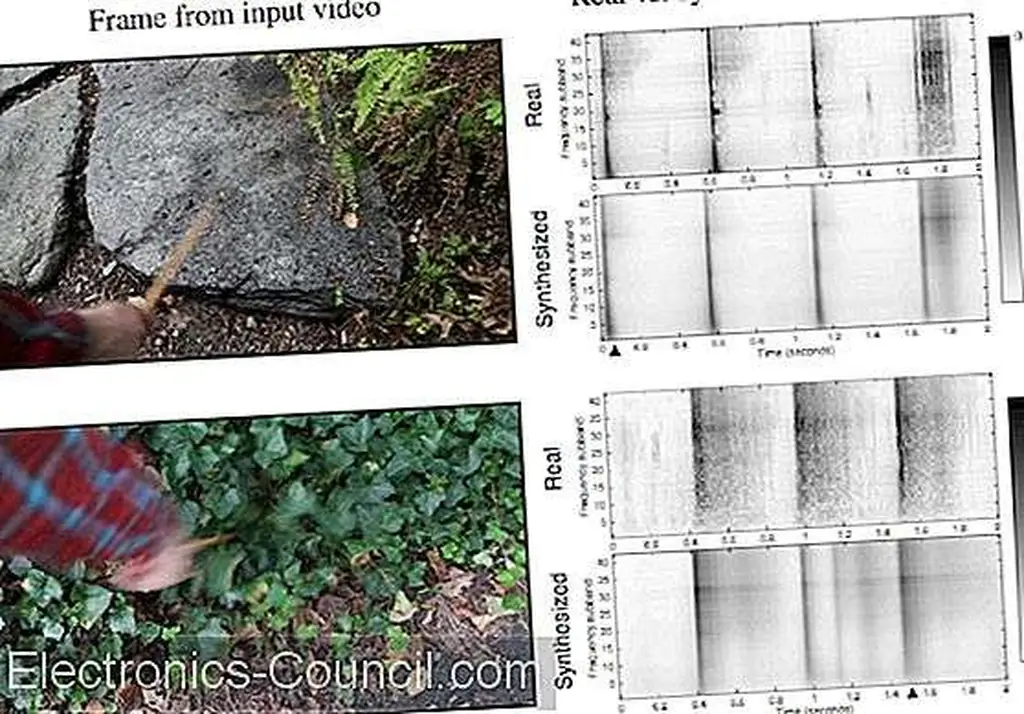

Затем алгоритм подавал приглушенные видеоролики барабанной палочки, поражающие различные объекты, и инструктировал производить звуковые эффекты, подходящие для каждого видео.

Для этого алгоритм использует параметрическую инверсию для создания звуков, а не для поиска в библиотеке звуков, чтобы найти правильное соответствие для видео, которое он видит. После того, как алгоритм создал разумный звуковой профиль (или cochleagram), он находит хорошее соответствие в базе данных, и это результат, который он предоставляет.

Изображение предоставлено MIT CSAIL. Нажмите, чтобы увеличить

Набор данных, который использовался, называемый «Величайшие хиты», теперь общедоступен для других, которые могут захотеть использовать его в своих собственных экспериментах. Звуки предварительно обрабатываются путем применения полосовых фильтров и создания конверта для простого представления отфильтрованной формы сигнала. Для каждого кадра найдено представление, и каждый кадр впоследствии отображается на звуковые функции.

Конечным результатом является то, что звуки, создаваемые алгоритмом, почти идентичны звукам, которые создаются естественными взаимодействиями, и люди не могут отличить друг от друга.

тестирование

Команда MIT использовала онлайн-исследование, чтобы проверить, насколько эффективно работает алгоритм глубокого обучения.

Тестам было показано два видеоматериала о физических взаимодействиях: один с реальным звуком и один с звуком, созданным алгоритмом. Затем их попросили выбрать, какой звук был «настоящим» или аутентичным саундтреком для каждого видео.

Результаты исследования состояли в том, что люди выбрали поддельный звук в два раза чаще, чем настоящий звук. Когда MIT сравнивал свой алгоритм с другими подобными алгоритмами, они обнаружили, что он превосходит лучший метод сопоставления изображений и базовый звук.

Алгоритм также был протестирован с использованием подхода ближайшего соседа на основе изображения, в частности, кадра, в котором происходит удар. Звук был протестирован с использованием центрированной модели для громкости и спектральных центроидов. Алгоритм также был проверен, чтобы определить, может ли он определять события воздействия, а не центрировать воздействие.

Следующие шаги

Успех алгоритма MIT имеет далеко идущие последствия. Одним из наиболее значительных выводов является то, что алгоритм может точно определять свойства материала, просто передавая его видео. Это шаг в сторону автономных транспортных средств, которые могут оценивать материалы вокруг них. Возможность предсказать звук может привести к тому, что можно предсказать реакцию на взаимодействие с чем-то в окружающей среде.

Но визуальный тест Тьюринга является всего лишь одним из компонентов полного прохождения теста Тьюринга. В машинах много сложностей, которые пытаются воспроизвести человеческие восприятия и действия.

В настоящее время MIT разрабатывает алгоритм для передачи визуального теста Turing, который отлично подходит для сообщества машинного обучения и, безусловно, является шагом к тому, чтобы машины понимали последствия взаимодействия с различными средами.

Есть еще другие аспекты теста Тьюринга, например, когда машина пытается воспроизвести, как люди будут взаимодействовать друг с другом, которые еще предстоит преодолеть.

На данный момент, однако, результаты MIT достигли множества очень полезных приложений для нескольких разных областей.

Посмотрите видео-описание процессов MIT: