Почему это важно: Не секрет, что у технологий автономного вождения есть несколько проблем. Полуавтономный инструмент вождения Tesla «Автопилот» неоднократно попадал в заголовки газет после того, как якобы было принято решение, которое привело к травме или смерти водителя. К несчастью для Tesla, исследователи нашли надежный способ заставить автопилот действовать в ущерб интересам водителя.

Вы можете подумать, что они сделали это, взломав программное обеспечение автомобиля или кардинально изменив работу автопилота, но на самом деле все намного проще.

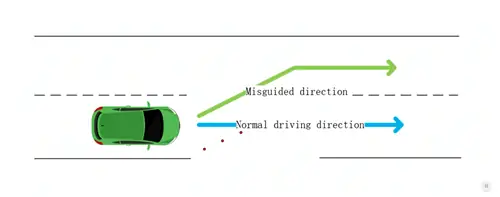

Все, что нужно было сделать исследователям, чтобы обмануть автопилот, это прикрепить три маленькие наклейки к дороге по диагонали. Сделав это, они обнаружили, что автопилот, кажется, считывает наклейки как своего рода индикатор слияния с полосой движения или указатель поворота, в результате чего их тестируемый автомобиль едет прямо на встречный транспорт.

Исследователи отмечают, что этот эксплойт «прост в развертывании» и требует только тех материалов, которые «легко получить». Теоретически, практически любой может наклеить эти почти невидимые наклейки и наблюдать за потенциальной бойней.

Что бы там ни было, в заявлении, отправленном по электронной почте Ars Technica, Tesla ясно дала понять, что не считает, что эта уязвимость вызывает беспокойство. Компания говорит, что, поскольку этот эксплойт требует, чтобы кто-то «изменил» окружающую среду вокруг автомобиля с автопилотом, это «нереалистичная проблема."

Tesla продолжает возлагать бремя ответственности на водителей, отмечая, что они могут и должны «всегда быть готовы» взять на себя управление рулем или тормозами, если автопилот сделает неверный вызов.