"Могут ли машины думать?" Давайте расширим этот вопрос, заданный Аланом Тьюрингом в 50-х годах. Бесчисленные сценарии катастроф, в которых искусственный интеллект (ИИ) захватывает мир и уничтожает человечество, уже выдуманы и до сих пор рассказываются в Голливуде.

ИИ еще не взял под свой контроль человечество, но он действительно взял под свой контроль многие аспекты нашей жизни, даже если мы не воспринимаем его таковым. Мы принимаем ИИ как часть нашей жизни. Самый простой пример - наши смартфоны!

Использование приложений ИИ в этой области настолько широко распространено, что теперь можно создавать решения практически для всех профессиональных групп. Медицина, образование, автомобилестроение, оборона, сельское хозяйство, автоматизация, энергетика, естественные науки, финансы, искусство и право!

Роль глубокого обучения

За последние 7 лет подобластью ИИ стало глубокое обучение. Глубокое обучение более успешно, чем люди, особенно при обработке визуальных данных и анализе изображений из изображений, о том, какие существуют объекты или живые существа, отношения друг с другом, оценка событий, отслеживание объектов / людей и т. д.

Глубокое обучение включает в себя модели ИИ, которые генерируют самые успешные результаты в прикладных областях последних лет, основанные на искусственных нейронных сетях и требующие большой вычислительной мощности.

Как системы искусственного интеллекта изучают язык?

Модели, используемые для обработки естественного языка, также находятся в рамках глубокого обучения.

Используя модели обработки естественного языка, мы можем анализировать миллионы файлов данных, загруженных в компьютер, по классам. В этом процессе система изучает отношения между словами из всех документов и способна предсказать, что слово «морковь» идет после слова «кролик» с большей вероятностью, чем слово «солнце».

AI может оценить это благодаря тому, что слова выполняют анализ значения на основе их статистического статуса в предложениях. Можно суммировать или классифицировать длинный абзац, включая пространственно-временную информацию из отдельных предложений.

ИИ для формирования смысловых сетей

С каждым днем в Интернете накапливается все больше и больше данных. Благодаря огромному объему данных мы можем реализовать приложения искусственного интеллекта, которые представляют собой самогенерирующиеся «сети значений».

Это не только информирует нас о социологическом, психологическом, этническом, социокультурном и экономическом уровнях сообществ или людей, живущих в регионе, но также помогает нам предсказать, где может быть развивающаяся горячая повестка, как и в случае с Президентские выборы в США.

Используя приложение голосового врача на нашем телефоне, мы можем попытаться определить, в чем заключается наш дискомфорт, и выполнить предварительные вмешательства с очень высокой точностью. Babylon, у которого более 40 000 пользователей в Великобритании, является образцовой практикой помощника врача с искусственным интеллектом.

Что, если ИИ попытается стать юристом?

Представьте, что «человек-адвокат» может вести все дела в мире после предварительного исследования ИИ.

Человеку-юристу требуется несколько недель, чтобы провести исследование, но ИИ может сделать это всего за несколько секунд. Более того, ИИ не устает, не спит, не ест и не пьет кофе. На самом деле ИИ может дать более успешные результаты, чем средний опытный юрист.

Что бы вы сказали на это? Искоренит ли весь этот искусственный интеллект, машинное обучение на основе всех этих данных потребность в юристах?

Лейбниц: первый юрист, предсказавший использование машин в законе

Лейбниц, который является одним из дедов ИИ, был юристом и сказал: «Недостойно превосходных людей терять часы, как рабы, в расчетном труде, который можно было бы безопасно поручить кому-либо другому». если использовались машины.'

В 1673 году он представил машину для четырех арифметических операций в Великобритании. Лейбниц говорит: «Единственный способ исправить наши рассуждения - это сделать их такими же осязаемыми, как математики», чтобы мы могли с первого взгляда найти свою ошибку, а когда между людьми возникают разногласия, давайте посчитаем и посмотрим, кто прав!»

Итак, давайте подумаем, почему машины не могут завершить все этапы цепочки событий, которая возникает в голове юриста, когда они принимают решение?

Почему машина не может этого сделать? Почему он не может вычислить, кто прав в споре между людьми или как найти золотую середину? Разве это не «робот-посредник»? Эти вопросы относятся к 17 веку! Хочу отметить, а мы в конце 2018 года!

Вклад AINOW в создание будущего юридического ИИ

'Поскольку люди, почти монополизировавшие все высшие формы разума, были одним из самых основных фактов человеческого существования на протяжении всей прошлой истории этой планеты, такое развитие событий, несомненно, привело бы к созданию новой экономики, новой социологии. и новая история!» говорит Дж. Шварц.

В июне 2018 года AINOW - исследовательский институт, изучающий социальные последствия ИИ, - созвал семинар с целью собрать вместе юристов, ученых и технических защитников, которые занимаются судебными разбирательствами алгоритмического принятия решений в различных областях. области права (например, занятость, общественные блага, уголовное правосудие).

Они организовали день с практической целью обсуждения стратегии и передового опыта, а также обмена идеями и опытом в судебных процессах и другой защите интересов в этом пространстве.

В собрании приняли участие несколько юристов, которые вели дела, а также адвокаты, исследователи, технические эксперты, социологи и другие ведущие мыслители в области алгоритмической ответственности.

Какова точность программ ИИ?

В 2017 году в ходе эксперимента, в котором приняли участие более 100 юристов в Лондоне, были рассмотрены сотни фактических заявлений омбудсмену по финансам в связи с определенным нарушением правил кредитной карты.

В то время как точность человеческого предсказания составляла 66,3%, программа ИИ, обученная предсказывать, принимать файлы или нет, достигла точности 86,6%.

Evisort для сокращения временных затрат судебной системы

Кроме того, в конце 2017 года четверо студентов Гарвардской школы права утверждали, что использование ИИ для составления проектов юридических контрактов и управления ими было очень точным ходом.

С помощью своей новой мощной поисковой системы под названием Evisort, которая использует облачное хранилище и искусственный интеллект, они надеются коренным образом изменить дорогостоящий и трудоемкий способ, которым юристы в настоящее время обрабатывают контракты и другую транзакционную работу, освобождая их для более творческих и интересные задания.

Когда они говорят: «За шесть секунд они могут просмотреть контракт на 30 страниц и вытащить для вас информацию», юристы говорят: «Зачем я потратил на это 10 лет своей жизни?» Именно эта реакция побуждает их продолжать.

Способ снижения затрат без ущерба для производительности и точности заключается в использовании моделей глубокого и машинного обучения при обработке естественного языка для юридической корреспонденции.

Сравнение работы ИИ-юристов и юристов-людей

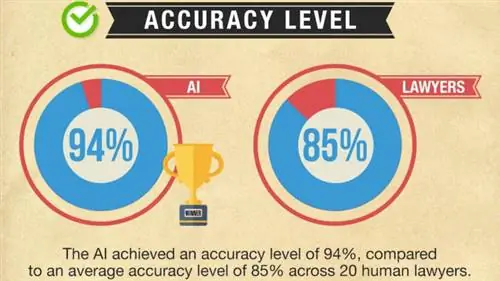

Еще одно текущее исследование было проведено компанией LawGeex, основанной в 2014 году. Они сравнили работу 20 опытных юристов Организации Объединенных Наций с их системами искусственного интеллекта и опубликовали отчет на 40 страницах.

Полученные результаты: В ежедневном задании по оценке юридических рисков самая высокая производительность среди юристов-людей составила 94%, самая низкая производительность - 64%, а средняя производительность - 85%, в то время как средний показатель ИИ был 94% успеха.

Кроме того, среднее время, необходимое «людям-юристам» для этого процесса, составляет 92 минуты, в то время как время, необходимое ИИ, составляет 26 секунд. ИИ может продолжать этот процесс долгое время без отдыха!

Исторические записи помогают системам искусственного интеллекта

Самая важная часть успеха этих исследований заключается в том, что данные регулярно встречаются на цифровых носителях. Гарвардская юридическая школа недавно поделилась на онлайн-платформе судебной практикой Соединенных Штатов Америки 360-летней давности по каждому из штатов с разработчиками ИИ.

Это важный ресурс для ускорения работы. Но самыми большими препятствиями для обработки естественного языка являются правила, специфичные для языка, и потребность в таких ресурсах на всех языках. Разработки на английском достаточно яркие, потому что большая часть данных регулярно доступна на этом языке.

Сотрудничество между человеком и ИИ-адвокатом

Как я упоминал в начале, эти приложения ИИ, которые разрабатываются с использованием данных, делают аналогичные выводы, просматривая миллионы случаев в прошлом, обеспечивая при этом более высокую производительность по сравнению с успехом группы юристы-люди.

Во всех этих примерах с ИИ юристы-люди вернули себе потерянное время. Искусственный интеллект позволяет человеку-юристу работать быстрее и с большим объемом данных. Эти системы ИИ показывают нам важность сотрудничества человека и ИИ. Это определило человека в петле. Он направлен на то, чтобы предоставить юристам больше консультаций и избавиться от утомительной работы.

Для многих приложений ИИ подход, ориентированный на человека, поддерживает идею сотрудничества человека и ИИ вместо конкуренции ИИ с человеком.

А как насчет субъективных наблюдений и предубеждений, которые хранятся в данных, используемых этими машинами? Если мотивы для передачи данных нездоровы, разве это не сделает решения неправильными? Может ли ИИ собрать парсер, связку, форматив, регенератор и оператор, которые включены в «человека-адвоката»?

Системы до сих пор могли принять предрассудки документов дела, такие как те, которые были приняты в соответствии с расистскими подходами в прошлом. Таким образом, системы ИИ в их нынешнем состоянии не подвержены социальным конфликтам, которые содержатся в контексте их создания.

Как мы обеспечиваем серьезное суждение, внимание, проницательное поведение, оценку и судебные данные, чтобы создать здоровое суждение? Возможно, машина действительно нуждается в предоставлении доступа к прошлым данным или в том, чтобы ее коллеги-люди манипулировали ею, чтобы преодолеть эти проблемы.

Вопросы по этике ИИ

Предназначены ли манипуляции для вмешательства в эволюцию машины и неправомерны ли они? Мы подходим к моменту, когда на повестке дня стоит вопрос об этике ИИ!

Получит ли адвокат поддержку от машины ИИ, выполняя свою работу? Будут ли у программного обеспечения ИИ свои права? Могут ли машины с ИИ участвовать в сделках по гражданскому или уголовному праву?

Когда мы даем один и тот же случай машинам, на которых установлены одни и те же программы, и когда мы хотим, чтобы каждая машина решала одну и ту же проблему более одного раза, будут ли различия в нюансах между этими решениями? Должно ли это быть? В соответствии со временем и пространством, как мы должны различать каждый случай?

Ну, считается ли сегодня «человек» «роботизированным» в профессиональном исполнении? Возможно, мы не можем избавить людей от предубеждений, но нам нужно держать людей подальше от ИИ, чтобы предотвратить предрассудки. Это вопросы, которые необходимо обсудить некоторое время.