Горячий вопрос: Вы бы позволили кому-то перелопатить годы активности в социальных сетях, если бы это увеличило ваши шансы на получение работы? Это основная предпосылка Predictim, технологии искусственного интеллекта, которая анализирует учетные записи нянь в Facebook, Instagram и Twitter, чтобы составить «рейтинг риска». Неудивительно, что сайты, на которые он опирается, блокируют его.

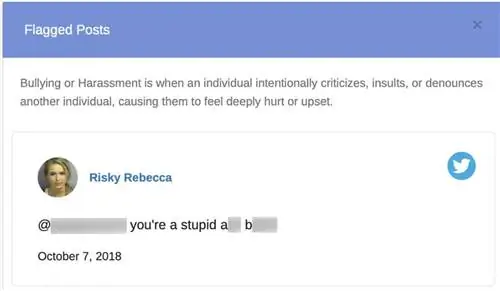

Predictim, финансируемый Калифорнийским университетом в ускорителе Skydeck в Беркли, использует алгоритмы обработки естественного языка и компьютерного зрения для поиска по постам в социальных сетях за годы. Затем система создает отчет, содержащий оценку риска, отмеченные сообщения и оценку четырех различных категорий личности: злоупотребление наркотиками, издевательства и домогательства, откровенный контент и неуважительное отношение.

Няня должна согласиться на запрос родителей о том, чтобы Predictim получила доступ к их учетным записям в социальных сетях, но система получила много критики с момента ее запуска в прошлом месяце. Это не только агрессивно, но и позволяет алгоритму решать, подходит ли кто-то для работы. Пара твитов, демонстрирующих «неуважительное отношение», не должна потенциально попасть в черный список из индустрии. Более того, всегда есть шанс, что пост может быть вырван из контекста, и даже если кто-то был рискованной няней, маловероятно, что он стал бы хвастаться своим употреблением героина и крупными преступлениями на Facebook.

Вы бы доверили Рискованной Ребекке своих детей?

Как сообщает BBC, в прошлом месяце Facebook закрыл большую часть доступа Predictim к пользователям после того, как было сочтено, что это нарушает политику использования персональных данных. Социальная сеть в настоящее время решает, следует ли полностью заблокировать фирму на платформе - Predictim заявляет, что продолжает собирать общедоступные данные Facebook для своих отчетов.

Twitter пошел еще дальше, сообщив BBC, что недавно заблокировал доступ Predictim к пользователям сайта. «Мы строго запрещаем использование данных и API Twitter в целях наблюдения, в том числе для проверки биографических данных», - заявила пресс-секретарь. «Когда нам стало известно об услугах Predictim, мы провели расследование и отозвали их доступ к общедоступным API Twitter».

Predictim заявила, что использует рецензентов для проверки отмеченных сообщений и предотвращения ложных срабатываний. За одно сканирование взимается 25 долларов, за два - 40 долларов, а за три - 50 долларов. Компания заявляет, что ведет переговоры с крупными компаниями «совместной экономики» о проведении проверки водителей совместных поездок или хостов службы размещения.

Скрапинг данных профиля - спорная тема. LinkedIn продолжает судебную тяжбу с hiQ Labs, которая использовала общедоступную информацию участников сети, чтобы компании могли контролировать сотрудников, тем самым определяя «пробелы в навыках или риски текучести кадров на месяцы раньше».