Элон Муск и Институт Будущего Жизни проводят предупреждения о технологии смертельного ИИ

Имя Элона Муска привлекает к себе большое внимание, особенно когда он предлагает мнения об ИИ, поле, которое испытывает астрономический рост. Но он не единственный, кто обеспокоен будущим ИИ, тем более что это касается оружия.

Недавно ряд информационных изданий опубликовал заголовки о президенте SpaceX Элоне Маске, призывающем Организацию Объединенных Наций принять меры против «убийственных роботов». Хотя это своего рода дух предполагаемого сообщения, то, что на самом деле произошло, немного отличается - и, конечно же, не было Муска в качестве единственного актера.

Институт Будущего Жизни (FLI) является конгломератом технических экспертов и других известных деятелей, работающих над обеспечением безопасности будущего человечества против экзистенциальных угроз. Случилось так, что эта организация выступила с заявлением в поддержку Конвенции Организации Объединенных Наций о конкретных видах обычного оружия (UNCCCW), которая недавно учредила Группу правительственных экспертов (GGE) для рассмотрения и консультирования по вопросам опасности и использования смертоносных автономных систем оружия. Это предложение дополняет типичный метод решения конкретных вопросов, которые могут повлиять на мир, а именно создание целенаправленных групп в рамках комитетов Организации Объединенных Наций.

Заявление, о котором идет речь, выпущенное в виде письма на веб-сайте Института, было подписано многими высокопоставленными членами, в том числе Муском, физиком Стивеном Хокином и актером Морганом Фриманом.

В письме содержится ссылка на собрание, которое должно было состояться 21 августа, отметив, что впервые ГЭГ встретится, чтобы обсудить эту тему, а также высоко оценивает назначение эксперта по вопросам разоружения и региональной безопасности Амандипа Сингха Гилла в качестве посла этой группы, Однако похоже, что эта встреча будет созвана в ноябре.

Усилия Элона Маска включают революцию в ракетной технике, электромобилях и солнечной энергии. Фото Дэн Тейлор пользовался любезностью Гейзенберга Медиа

Хотя заголовок, который Муск предупреждает миру о роботах-убийцах, привлекателен, реальность в отношении злоупотребления технологией остается реальной, даже если она не так сенсационна в реальности. Люди, использующие технологии против других людей, являются последовательной и регулярной угрозой, поскольку гонка ядерных вооружений является как историческим примером, так и постоянной угрозой.

В начале 2015 года FLI также опубликовала открытое письмо, призывающее международное научно-техническое сообщество обеспечить, чтобы искусственный интеллект по-прежнему использовался для блага человечества. С тех пор более 8000 человек подписали письмо в поддержку.

Сегодняшнее ядерное разоружение, роботы-убийцы завтрашнего дня

Существуют аргументы в пользу того, что автономное оружие может спасать жизни, ограничивать потери и ускорять исход конфликта, который в противном случае может длиться годами. Часть этих аргументов - это утверждение о том, что автоматическая природа такого оружия устраняет человеческие ошибки и суждения, а также удаляет людей (по крайней мере, со стороны агрессора) из-за вреда.

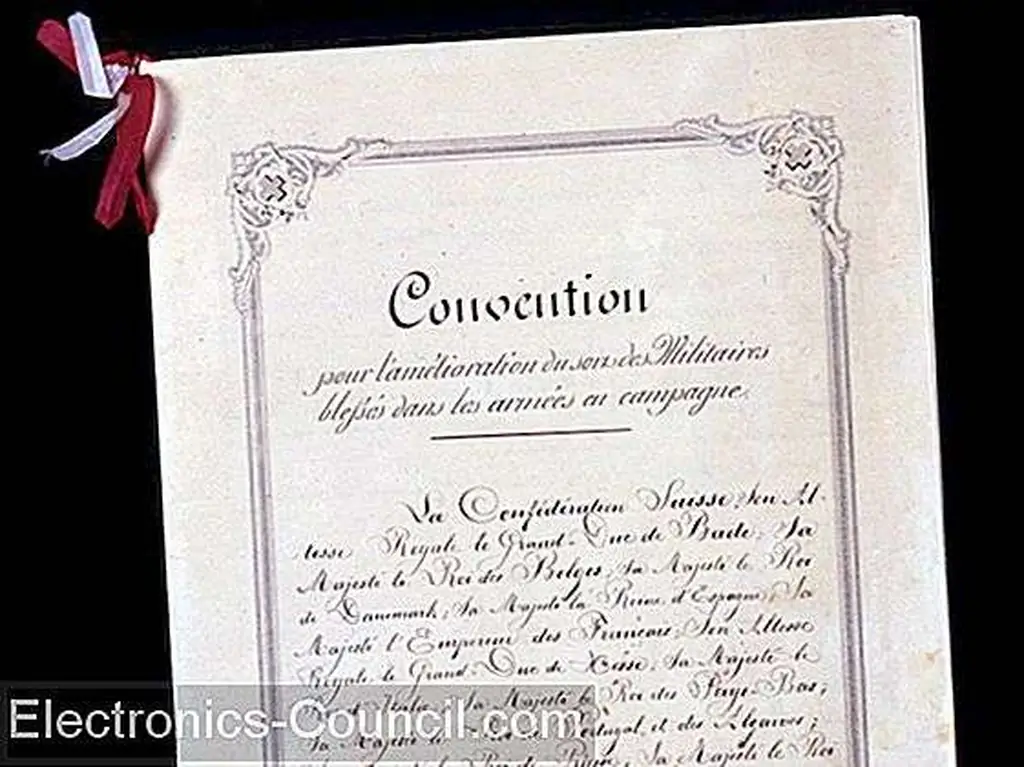

Однако в этических, политических и военных сферах одна из теорий, используемых для ведения войны, - это «jus bellum iustum», латынь для «теории справедливой войны». В широком смысле это философская теория, которая предусматривает такую природу ведения войны и то, как мы ее оправдываем. Эти разговоры об автономном оружии приносят часть этой теории, которая охватывает то, как война проводится после ее начала, известная как «jus in bello» (буквально «справедливость на войне»). Этот термин используется многими организациями, включая такие гуманитарные группы, как Международный комитет Красного Креста.

Эта философия в целом утверждает, что война должна быть пропорционально сражаться и должна быть вызвана военной необходимостью. Также принято утверждать, что комбатанты не должны нацеливаться на не-комбатанты (например, гражданские лица), справедливо относиться к военнопленным и не должны вести зло (также известное как «малам в сем»).

Именно этот последний бит, малам, был поднят в дискуссиях о ядерном, биологическом и химическом оружии. Это также то, к чему многие из экспертов, участвующих в FLI, относятся к автономному смертоносному оружию.

Женевские конвенции являются важным примером договоров, поддерживающих jus in bello. Изображение предоставлено Федеральным архивом Швейцарии

Хотя технологии и технологические достижения всегда использовались в войне для достижения преимущества (думаю, римская фаланга или катапульта), беспокойство заключается в том, что нынешняя технология уже может привести к войне, в которой разрушительна война. Обеспечение такого автономного вооружения может усугубить эти проблемы, отказавшись от принятия решений в наших автоматизированных системах и, в частности, нарушит аспект пропорциональности jus in bello.

Согласно заявлению ИФЛ, «смертоносное автономное оружие угрожает стать третьей революцией в войне. После того, как они будут разработаны, они позволят вооруженному конфликту сражаться в масштабе, который больше, чем когда-либо, и в разы быстрее, чем люди могут понять».

FLI также упоминает некоторые из его основных проблем в отношении автономного смертоносного оружия, в частности: что такое оружие можно использовать для терроризации, его можно было бы взломать и использовать нежелательными способами и использовать его в гораздо более быстром масштабе времени.

Роль технологии Drone

Передовые технологии уже используются с регулярностью воинских усилий многих стран. В то время как слово «беспилотный» может привлечь внимание к квадроциклам и другим устройствам потребительского типа, военные беспилотники также относятся к беспилотным военным летательным аппаратам (БПЛА), которые дистанционно управляются для проведения военных миссий.

В настоящее время только США имеют технологию дальнего действия, способную выполнять такие операции; несколько других стран имеют более ограниченную технологию беспилотных летательных аппаратов с более быстрыми диапазонами. Авторы (ученые из Университета Пенсильвании, Корнелла и Техаса A & M) считают, что это будет много лет, пока другие страны не будут иметь аналогичные возможности.

Гул MQ-9 Reaper. Фотография военно-воздушных сил США фото / Персонал сержант. Брайан Фергюсон через Фотоархив USAF

Тем не менее, эта технология дронов по-прежнему управляется «пилотом», даже если она находится на расстоянии. Беспилотники не принимают полностью автоматизированных решений о том, кто и для чего нацелен. Они также по-прежнему ограничены в радиусе действия и сколько полезной нагрузки (AKA, сколько оружия) они могут нести.

С другой стороны, технология беспилотного летательного аппарата и БПЛА часто используется в гуманитарных усилиях, отслеживая мигрантов на море, доставляя медицину, наблюдая и изучая штормы, и визуализируя береговые линии, чтобы помочь ученым определить такие вещи, как эрозия.

БПЛА, в частности, поднимают много вопросов о том, как ИИ можно использовать в войне из-за их дистанционно контролируемого характера.

Другие организации, поддерживающие причину

Помимо Института Будущего Жизни, есть еще несколько организаций, которые также активно проводят кампанию за пропаганду мирного и полезного использования технологий для людей. Кампания «Остановить убийственные роботы» - это международная организация, которая объединяет различные НПО, компании и отдельных экспертов со всего мира для защиты от летальных, автономных технологий.

Такие компании, как Canadian Clearpath Robotics, согласились поддержать миссию кампании по обеспечению мирного использования робототехники. Аналогично FLI, кампания «Остановить убийственные роботы» выступила с заявлением об отмене первого собрания 21 августа GGE, выразив разочарование.

Международный комитет по борьбе с роботизированными вооружениями является некоммерческой организацией, которая также выступает за предотвращение смертельного использования роботизированных технологий. В их состав входят специалисты в области робототехники, техники, международных отношений, международной безопасности и контроля над вооружениями.

Технология имеет возможность оказывать положительное воздействие на человечество, и, похоже, в мире много людей, которые прилагают все усилия для обеспечения того, чтобы это продолжалось. Как усилия этих организаций влияют на решения регулирующих органов, пока не видно. В то же время огромный рост индустрии ИИ продолжается, поскольку тысячи компаний по всему миру в сотнях месторождений продолжают добиваться новизны и эффективности использования нейронных сетей.